国家超算互联网平台上线了DeepSeek开源周第三弹DeepGEMM,可快速下载安全可信的源码文件。超算互联网平台AI社区上线了阿里云视频生成大模型万相2.1(Wan),支持免费下载模型文件。

DeepSeek开源周第三弹DeepGEMM上线超算互联网

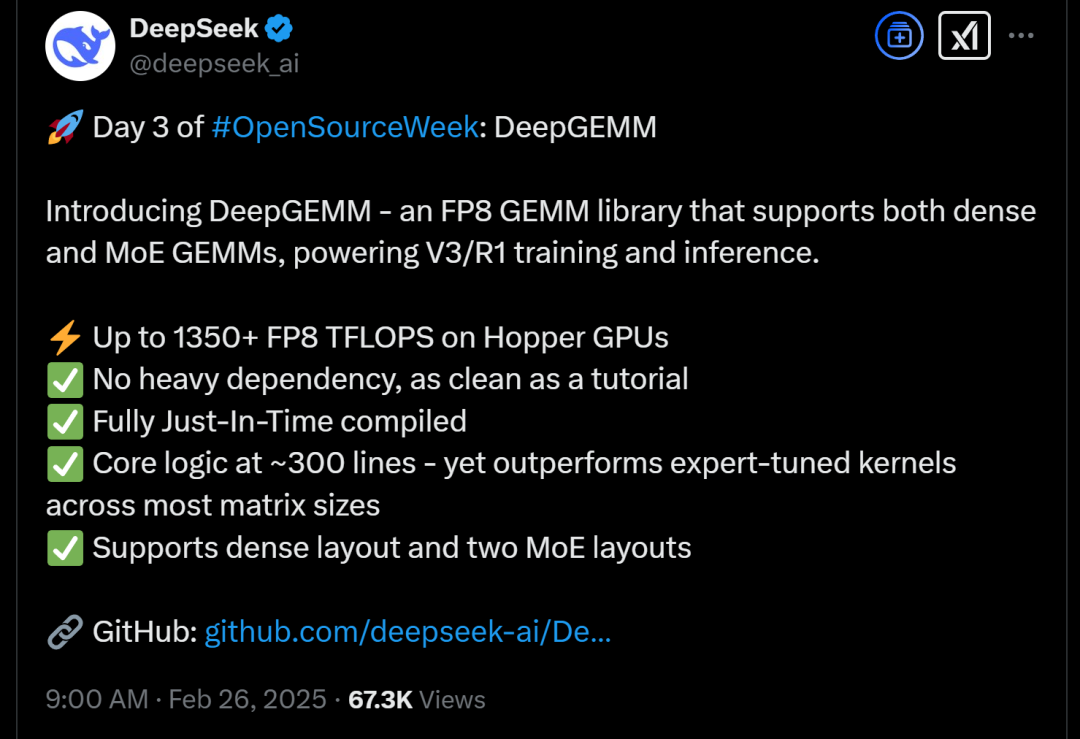

DeepGEMM是一款高效的FP8通用矩阵乘法(GEMM)库,支持密集和混合专家(MoE)矩阵乘法运算,为V3/R1训练和推理提供强大支持。DeepGEMM依旧保持了“高性能+低成本”的特性。

国家超算互联网即刻上线DeepGEMM。

据DeepSeek介绍,DeepGEMM库具有以下特征:

在Hopper GPU上实现高达1350+ FP8 TFLOPS的算力 极轻量级依赖,代码清晰易懂 完全即时编译 核心逻辑仅约300行代码,却在大多数矩阵规模上超越专家调优的内核 同时支持密集布局和两种MoE布局

目前,国家超算互联网已上线FlashMLA、DeepEP和DeepGEMM,并将持续跟进DeepSeek开源周发布的技术成果。

DeepGEMM下载地址:

https://www.scnet.cn/ui/mall/search/global?keyword=DeepGEMM

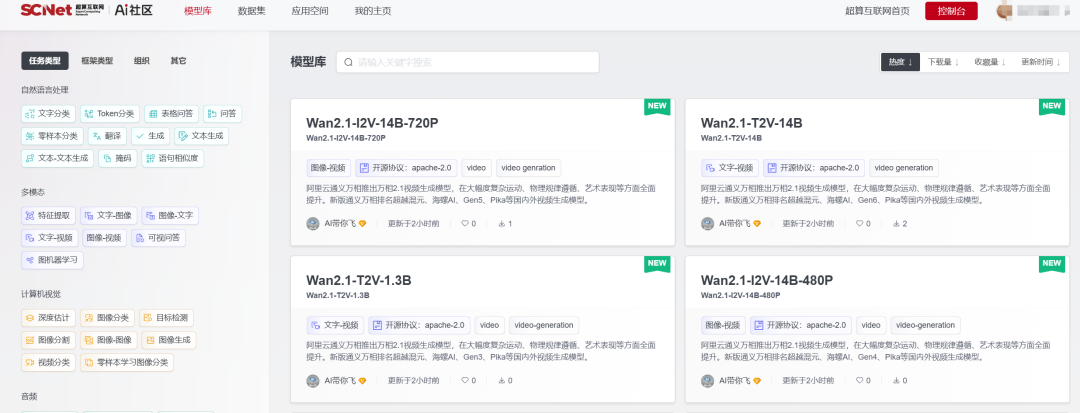

阿里云视频生成大模型万相2.1上线超算互联网

2月25日,阿里云视频生成大模型万相2.1(Wan)重磅开源。

万相2.1共有两个参数规模:14B和1.3B,同时支持文生视频和图生视频任务。14B参数模型适用于对生成效果要求更高的专业人士,1.3B参数模型生成速度较快且能兼容所有消费级GPU。

刚刚,万相2.1(Wan)已上线超算互联网AI社区。

万相2.1的两大核心创新为:

高效的因果3D VAE:万相团队自研了一种专为视频生成设计的新型因果3D VAE 架构,并结合多种策略来改进时空压缩、降低内存使用以及确保时间因果性。 视频Diffusion Transformer:万相模型架构基于主流的视频DiT 结构,通过Full Attention机制确保长时程时空依赖的有效建模,实现时空一致的视频生成。模型的整体训练则采用了线性噪声轨迹的流匹配(Flow Matching)方法。

万相2.1的主要优势集中于以下五点:

SOTA性能:万相2.1在多个基准测试中优于现有的开源模型和商业解决方案,14B参数专业版万相模型在权威评测集VBench中,以总分86.22%大幅超越Sora、Luma、Pika等国内外模型,居于榜首。 支持消费级GPU:1.3B参数模型仅需8.2GB显存就能生成480P视频,可兼容几乎所有消费级GPU,约4分钟内(未使用量化等优化技术)在RTX 4090上生成5秒的480P视频。 多项任务:同时支持文生视频、图生视频、视频编辑、文生图和视频生音频。 视觉文本生成:万相2.1是首个能够生成中英文文本的视频模型,无需外部插件就能生成文字。 强大的视频VAE:Wan-VAE提供卓越的效率和性能,可对任意长度的1080P视频进行编码和解码,同时保留时间信息。

万相2.1(Wan)下载地址:

https://www.scnet.cn/ui/aihub/models?order=popularity&keyword=Wan2.1&desc=true

相关新闻

-

2025-09-26

超算互联网筑基“气象大脑”,数据共享叩开商业气象新生态

-

2025-09-26

超算&AI应用周报Vol.75 | 创作专属手办!腾讯3D生成模型上线,免费试玩

-

2025-09-24

Qwen系列上线,多图编辑模型Qwen-Image-Edit新版、全模态大模型Qwen3-Omni、视觉语言模型Qwen3-VL

-

2025-09-24

国家超算互联网与安徽省算力统筹调度平台互联互通

-

2025-09-24

国家超算互联网与安徽省算力统筹调度平台互联互通