应用周报

每周带来超级计算与人工智能的热点资讯,聚焦超算&AI快讯、前沿应用、学术研究、最佳实践等行业热点、前沿趋势、商城动态。

热门软件模型持续更新中,关注【超算互联网】公众号,每周抢先体验最新超算应用。

超算AI快讯

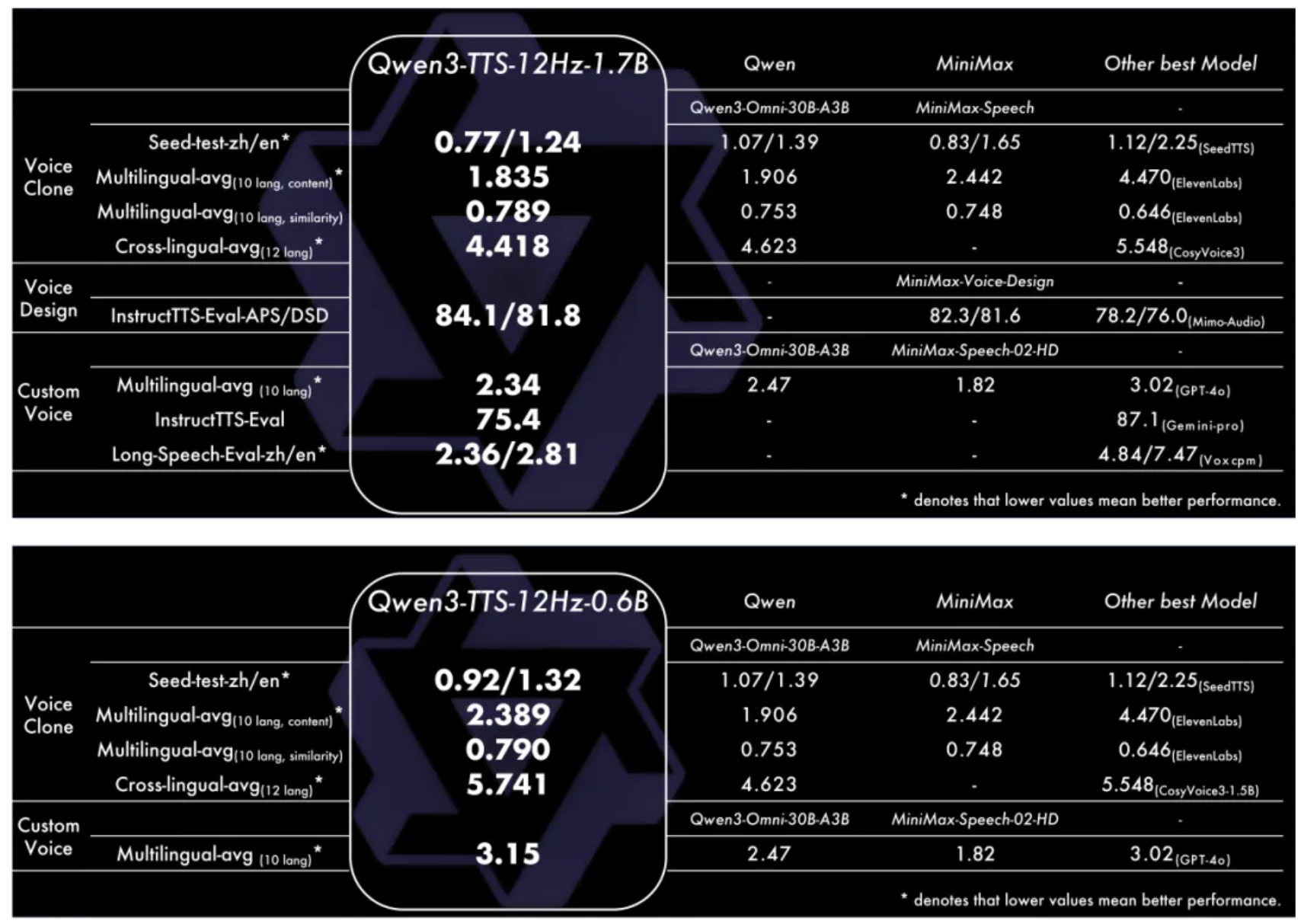

阿里语音生成模型Qwen3-TTS全家桶上线,支持10种语言

刚刚,超算互联网 AI 社区上线阿里Qwen3-TTS全家桶,用户可下载模型文件进行快速开发。该模型是由千问团队开发的一系列功能强大的语音生成,全面支持音色克隆、音色创造、超高质量拟人化语音生成,以及基于自然语言描述的语音控制,为开发者与用户提供最全面的语音生成功能。

依托创新的 Qwen3-TTS-Tokenizer-12Hz 多码本语音编码器,Qwen3-TTS 实现了对语音信号的高效压缩与强表征能力,不仅完整保留副语言信息和声学环境特征,还能通过轻量级的非 DiT 架构实现高速、高保真的语音还原。Qwen3-TTS 采用 Dual-Track 双轨建模,达成了极致的双向流式生成速度,首包音频仅需等待一个字符。

Qwen3-TTS 多码本全系列模型均已开源,包含1.7B和0.6B两种尺寸,1.7B可以达到极致性能,具有强大的控制能力,0.6B均衡性能与效率。模型覆盖 10 种主流语言(中文、英文、日语、韩语、德语、法语、俄语、葡萄牙语、西班牙语、意大利语)及多种方言音色,满足全球化应用需求。

同时,模型具备强大的上下文理解能力,可根据指令和文本语义自适应调整语气、节奏与情感表达,并对输入文本噪声的鲁棒性有显著提升。

您可点击商品详情 (scnet.cn)抢先体验。

智谱GLM-4.7-Flash上线,兼顾性能与效率

本周,超算互联网 AI 社区上线智谱 GLM-4.7-Flash,支持下载模型文件进行快速开发。GLM-4.7-Flash 是一个混合思考模型,总参数量为30B,激活参数量为3B,作为同级别SOTA模型,为轻量化部署提供了一个兼顾性能与效率的新选择。

在SWE-bench Verified、τ²-Bench等主流基准测试中,GLM-4.7-Flash的综合表现超过gpt-oss-20b、Qwen3-30B-A3B-Thinking-2507,在相同和近似尺寸模型系列中取得开源SOTA分数。在内部的编程实测中,GLM-4.7-Flash在前、后端任务上表现出色。在编程场景之外,智谱也推荐大家在中文写作、翻译、长文本、情感/角色扮演等通用场景中体验GLM-4.7-Flash。

您可点击商品详情 (scnet.cn)抢先体验。

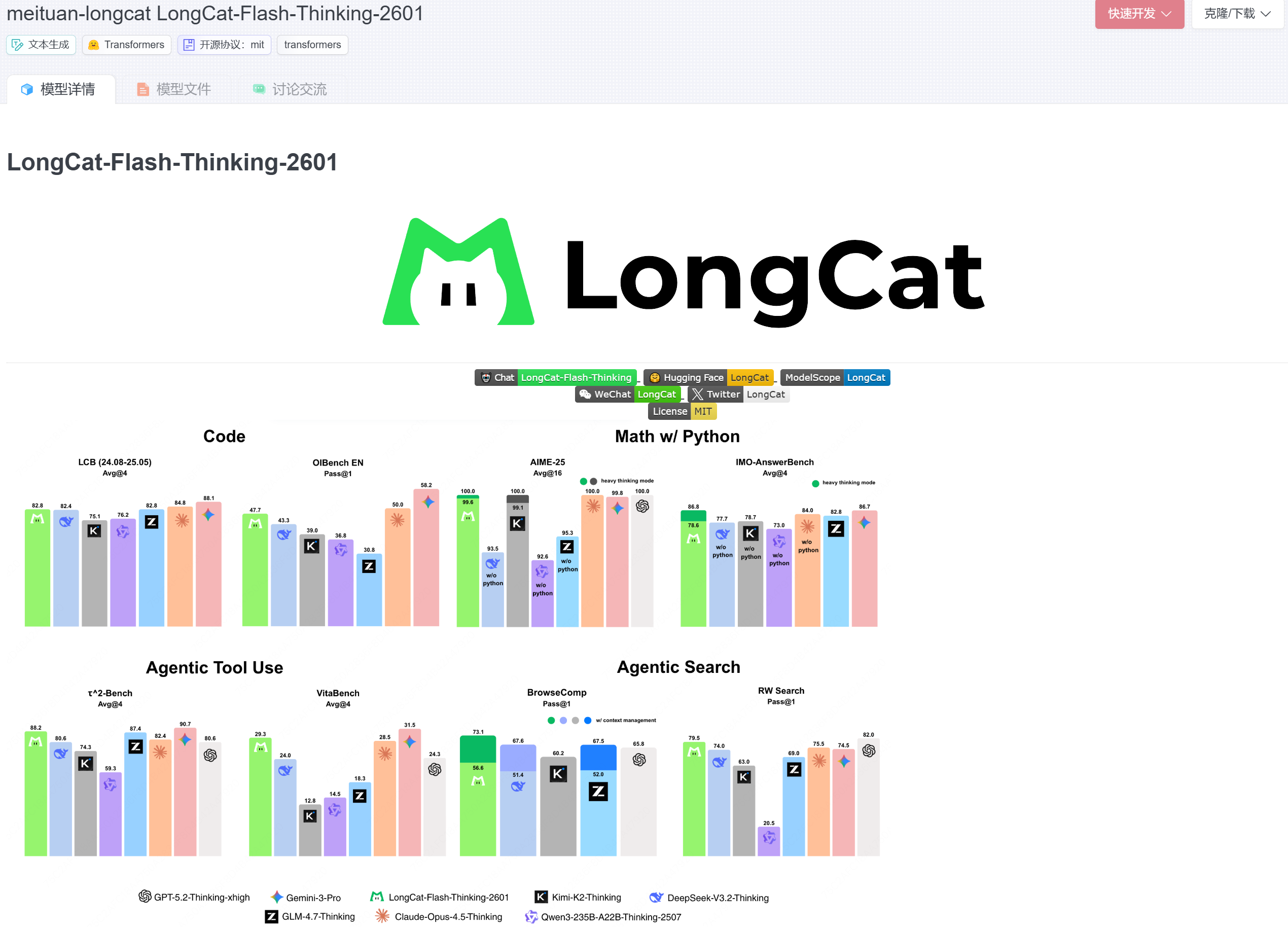

美团LongCat-Flash-Thinking-2601上线,工具调用能力登顶开源SOTA!

本周,超算互联网 AI 社区上线美团开源模型 LongCat-Flash-Thinking-2601。作为已发布的 LongCat-Flash-Thinking 模型的升级版,LongCat-Flash-Thinking-2601在Agentic Search(智能体搜索)、Agentic Tool Use(智能体工具调用)、TIR(工具交互推理)等核心评测基准上,均达到开源模型 SOTA 水平。

该模型尤其在工具调用上表现出卓越的泛化能力,在依赖工具调用的随机复杂任务中性能超越了 Claude,可大幅度降低真实场景下新工具的适配训练成本;同时它完整开源并支持在线免费体验「重思考模式」的模型,同时启动 8 个大脑飞速运转,确保思考周全、决策可靠。

经过全面严谨的评估显示,LongCat-Flash-Thinking-2601 模型在编程、数学推理、智能体工具调用、智能体搜索维度表现全面领先:

编程能力:LongCat-Flash-Thinking-2601 在 LCB 评测中取得 82.8 分,OIBench EN 评测获 47.7 分,成绩处于同类模型第一梯队,展现出扎实的代码基础能力。数

学推理能力:在开启重思考模式后表现突出,LongCat-Flash-Thinking-2601 在 AIME-25 评测中获 100.0 分(满分),IMO-AnswerBench 中以 86.8 分达到当前 SOTA。

智能体工具调用能力:在 τ²-Bench 评测中拿到 88.2 分,VitaBench 评测中获得 29.3 分,均获得开源 SOTA 水平,在多领域工具调用场景下表现优异,适配实际应用需求。

智能体搜索能力:在 BrowseComp 任务中取得 73.1 分(全模型最优),RW Search 评测获 79.5 分,LongCat-Flash-Thinking-2601 具备强劲的信息检索与场景适配能力,达到开源领先水平。

您可点击商品详情 (scnet.cn)抢先体验。

阶跃星辰视觉语言模型Step3-VL-10B上线,10B击败200B!

本周,阶跃星辰10B视觉语言SOTA模型Step3-VL-10B上线超算互联网。仅用 10B 参数量,Step3-VL-10B 在视觉感知、逻辑推理、数学竞赛以及通用对话等一系列基准测试中均达到同规模 SOTA 水平,并且解决了参数量小和智能水平高难以兼优的行业难题。

在多项关键评测中,Step3-VL-10B 媲美甚至超越规模大 10-20 倍开源模型(如 GLM-4.6V 106B-A12B、Qwen3-VL-Thinking 235B-A22B)以及顶级闭源旗舰模型(如 Gemini 2.5 Pro、Seed-1.5-VL)。基于这样一个小而强底座,原本只能在云端运行的复杂多模态推理(如 GUI 操作、复杂文档解析、高精度计数)能够下沉到手机、电脑甚至工业嵌入式设备中。

Step3-VL-10B 具备三大核心亮点:

极致视觉感知标杆:在同参数量级中展现出顶尖的识别与感知精度。通过引入 PaCoRe(并行协调推理) 机制,模型在复杂计数、高精度 OCR 及空间拓扑理解等高难度任务上的可靠性实现了质的飞跃。

深层逻辑推演与长程推理:得益于规模化强化学习(RL)的持续迭代,Step3-VL-10B 在 10B 规模上实现了跨任务推理能力的阶跃。无论是竞赛级数学难题、真实编程环境还是视觉逻辑谜题,模型均能通过严密的多步思维链推导出最终答案。

强大端侧 Agent 交互:基于海量 GUI(图形用户界面)专用预训练数据,模型能够精准识别并操作复杂界面,成为端侧 Agent 的核心引擎。

您可点击商品详情 (scnet.cn)抢先体验。

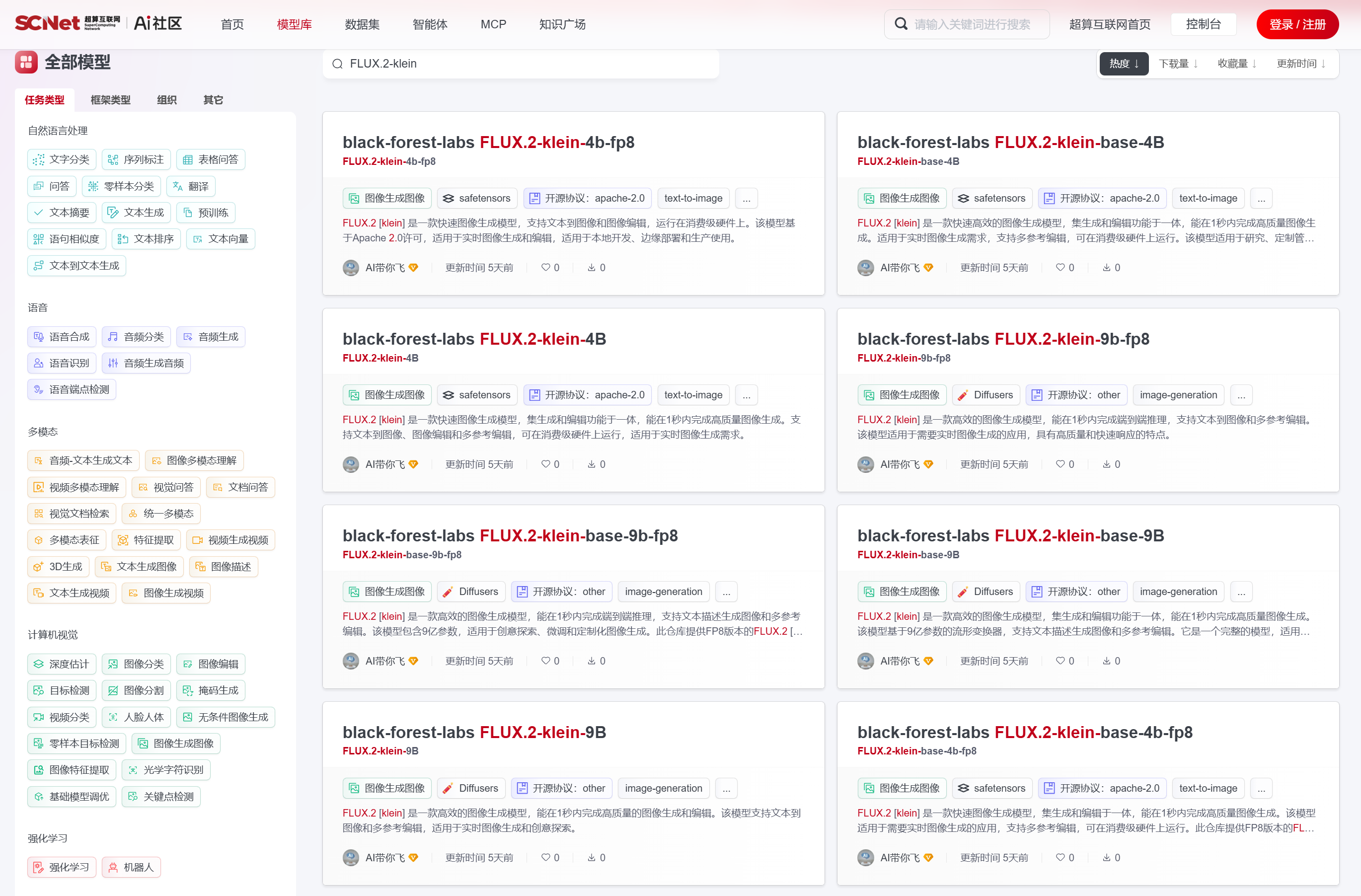

FLUX.2-Klein 4B/9B上线,亚秒级统一图像生成与编辑

本周,Black Forest Labs开源FLUX.2 [klein]模型家族上线超算互联网。该系列在单一紧凑架构中统一了生成和编辑能力,在现代硬件上实现端到端推理低至0.5秒以内,同时在消费级GPU上仅需13GB显存即可运行。

模型的核心特性如下:

亚秒级推理速度:在现代硬件上,生成或编辑图像耗时低于0.5秒,大幅提升实时应用的响应速度。

统一生成与编辑架构:单一模型支持文生图(Text-to-Image)、图像编辑(Image-to-Image)和多参考图像生成,无需切换不同模型即可完成复杂的视觉任务。

消费级硬件友好:4B模型在RTX 3090/4070及以上显卡运行时仅占用约13GB显存,降低了开发和部署门槛。

高质量输出:在质量与延迟的帕累托前沿上表现优异,9B版本的性能可与5倍参数规模的模型匹敌。

完全开源与商业友好:4B系列采用Apache 2.0许可证,支持商业使用;9B系列采用FLUX非商业许可证,适用于研究和非商业场景。

量化加速支持:提供FP8和NVFP4量化版本,在RTX GPU上分别实现最高1.6倍和2.7倍的推理加速,显存占用分别降低40%和55%。

您可点击商品详情 (scnet.cn)抢先体验。

前沿应用

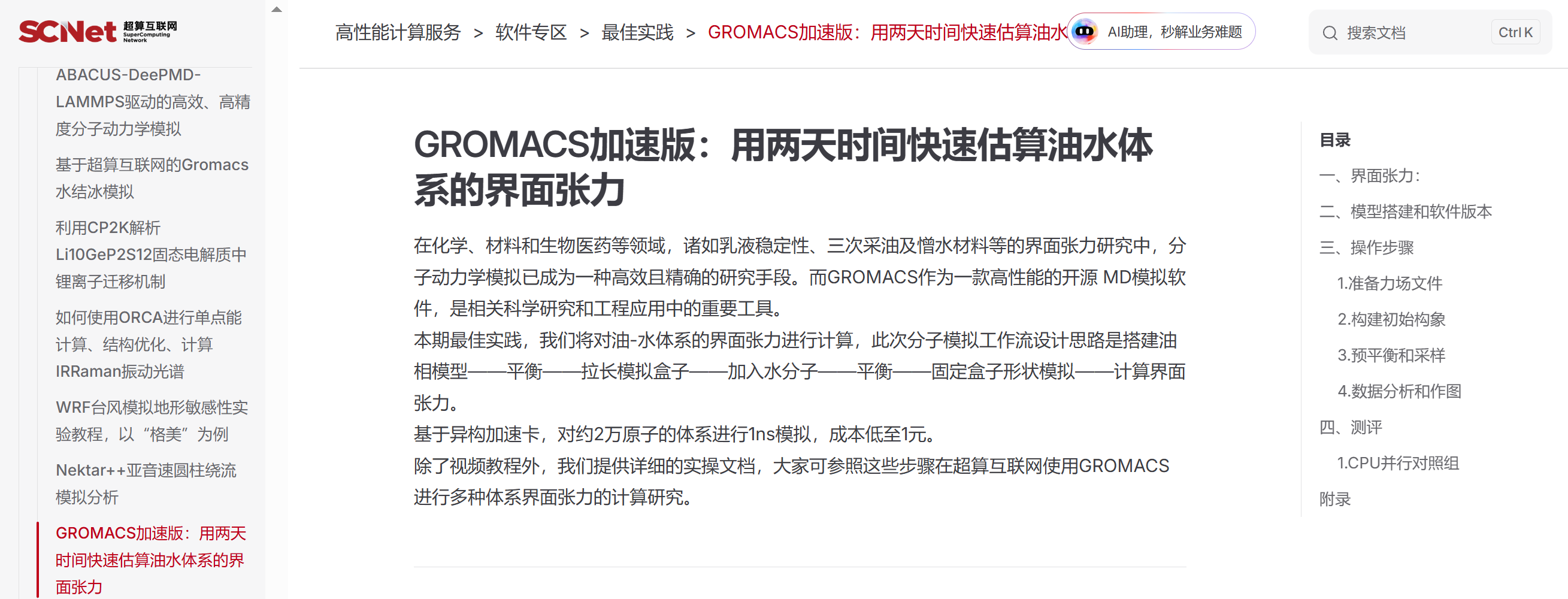

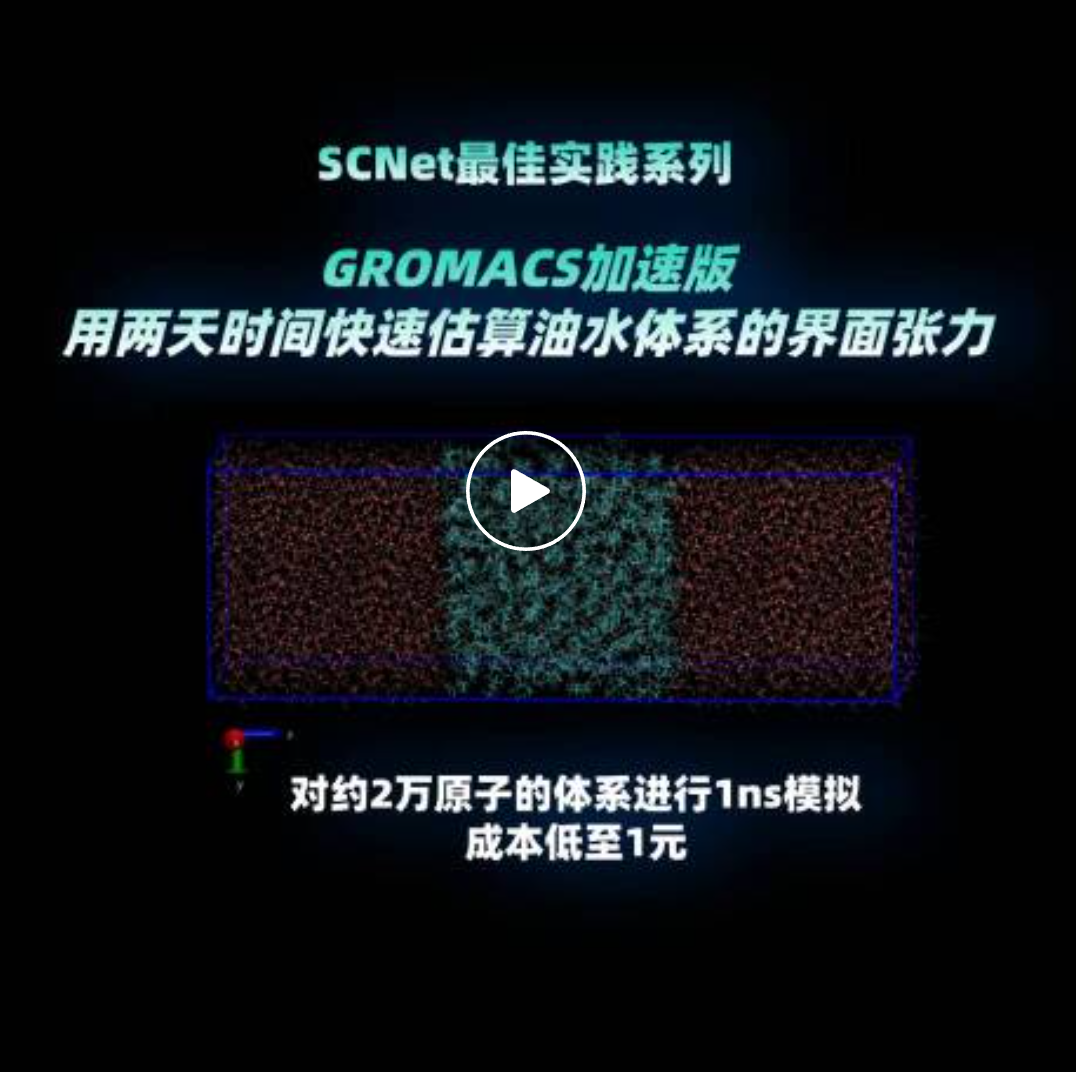

最佳实践Vol.59 | GROMACS加速版:用两天时间快速估算油水体系的界面张力

本期最佳实践,我们将在超算互联网平台使用 GROMACS v2023.2 加速版,对油-水体系的界面张力进行计算,此次分子模拟工作流设计思路是搭建油相模型——平衡——拉长模拟盒子——加入水分子——平衡——固定盒子形状模拟——计算界面张力。计算表明,基于国产异构加速卡,对约 2 万原子的体系进行 1ns 模拟,成本低至 1 元。

除了视频教程外,我们提供详细的实操文档,大家可参照这些步骤在超算互联网使用 GROMACS 进行多种体系界面张力的计算研究。

使用教程文档:

https://www.scnet.cn/help/docs/mainsite/hpc/software-examples/practice/gromacs4/

马斯克开源X推荐算法!100%AI驱动,0人工规则

近日,X平台全新推荐算法正式开源!这套由Grok驱动的AI系统,完全取代了人工规则,通过15种行为预测精准计算每条帖子的命运。正式开源新的 X 推荐算法——该算法采用了与 xAI 的 Grok 模型相同的 Transformer 架构。这次 X 平台开源的是「For You(为你推荐)」信息流的核心推荐系统。

据 X 工程团队介绍,「For You」信息流的内容主要来自两大来源:一是站内内容(Thunder 模块),即用户关注账号发布的帖子;二是站外内容(Phoenix 召回模块),也就是从全网内容库中筛选出的帖子。两类内容整合后,会交由 Phoenix 模型(基于 Grok Transformer 模型,Transformer 实现移植自 xAI 开源的 Grok-1,并针对推荐系统的具体使用场景进行了适配和调整)分析——该模型会通过用户的点赞、回复、转发等互动历史,预测用户对每篇帖子的各类互动概率,最终的内容得分便是这些概率的加权组合。

X 工程团队还透露,该系统已剔除所有手工设计的特征及绝大部分启发式规则,核心计算工作完全由这款 Grok Transformer 模型承担,其核心逻辑就是通过分析用户互动历史,判断内容与用户的相关性。Phoenix模型会预测用户可能对每条帖子采取的多种行为。算法不是简单看你获得了多少点赞,而是预测用户看到这条帖子后会怎么做。

学术研究

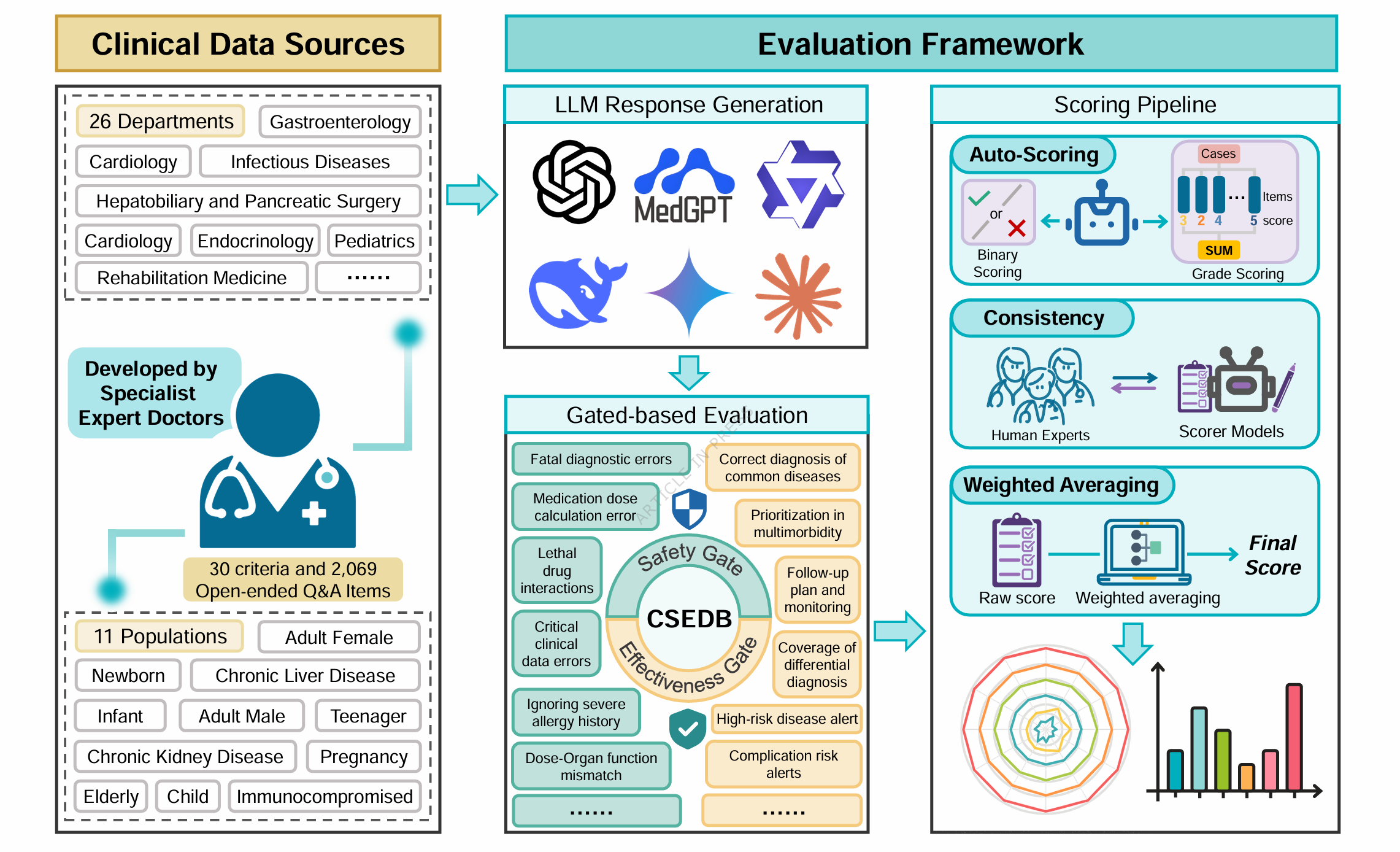

中国团队发布医疗AI标准,未来医生MedGPT全球登顶

近日,中国AI医疗公司“未来医生”协同32位来自北京协和医院、中国医学科学院肿瘤医院、北京大学口腔医院、中国医学科学院阜外医院、中国人民解放军总医院、复旦大学附属华山医院、上海市同济医院等顶尖医疗机构的23个核心专科的一线临床专家,共同提出了一套用于评估医疗大模型真实临床能力的系统性框架。

论文链接:https://www.nature.com/articles/s41746-025-02277-8

CSEDB全称为Clinical Safety-Effectiveness Dual-Track Benchmark(临床安全性与有效性双轨基准),它首次为评估医疗AI真实临床能力建立了一个基于临床专家共识、覆盖全面风险维度,并将安全性与有效性分开考量的标准化基准。通过公开实验,CSEDB直接给出了不同模型在同一标尺下的临床能力对照结果。

最为创新的地方,在于CSEDB在医疗AI评估中首次引入了“安全性”与“有效性”双轨评价体系。与以往算总分的评测标准不同,CSEDB一条轨道专注安全性,另一条轨道衡量有效性,只有同时通过这两道门槛,模型才被认为具备临床部署的基本资格。

更关键的是,CSEDB还进一步在指标设计上引入了风险权重机制,每一项评估指标都会根据其潜在临床风险,被赋予1到5级的权重。为了支撑好CSEDB,专家团队特意构建了一个面向真实临床问题的数据集。整套评估体系共涵盖了2069个开放式问答条目,覆盖26个临床专科。

在这套框架下,专家团队评估了全球范围内的主流大模型,包括DeepSeek-R1、OpenAI o3、Gemini-2.5、Qwen3-235B、Claude-3.7等在内,悉数接受了这套严格测试。结果颇具冲击力,在总体得分、安全性和有效性三个核心维度上,中国未来医生团队推出的MedGPT均位列第一。尤其在安全性指标上,MedGPT与其他模型拉开了显著差距,更是唯一一个在安全性评分上超过有效性的模型。

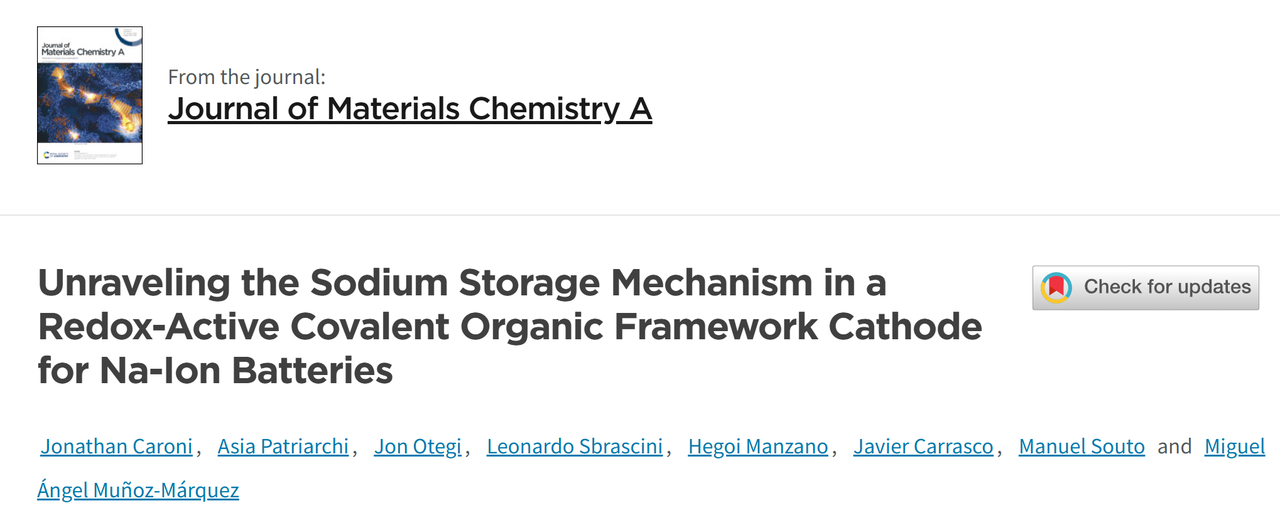

「MD模拟+电化学方法」,揭示钠金属电池正极的储钠机制

近日,西班牙圣地亚哥德孔波斯特拉大学(圣地亚哥大学)研究团队在《Journal of Materials Chemistry A》上发表研究成果。

论文链接:https://doi.org/10.1039/D5TA08017G

该研究通过结合电化学、物理化学及计算模拟方法,揭示了基于β-酮烯胺蒽醌的共价有机框架作为钠金属电池正极时的储钠机制。与先前研究提出的电容存储机制不同,结果表明其存在赝电容与法拉第过程的协同作用。分子动力学模拟结合非原位X射线衍射研究证实,钠存储通过与共价有机框架孔道内的羰基相互作用实现,而非通过层间插层机制。此外,电极压延实验表明法拉第过程贡献受多孔共价有机框架结构调控。最终,通过计算模拟与电化学测量共同证明了β-酮单元中羰基的氧化还原惰性。这些结果进一步强化了蒽醌单元作为该类有机电极材料中唯一储钠活性位点的作用。

【投稿征集】

投递邮箱:scnet_contest@163.com

也可扫描下方二维码添加超算互联网小编企业微信进行投稿。还可入群交流,共同探讨 AI4S 发展,快速把握科研领域的热点资讯。

产品推荐

-

Qwen3-TTS

阿里语音生成模型Qwen3-TTS全家桶上线,支持10种语言

-

Step3-VL-10B

阶跃星辰视觉语言模型Step3-VL-10B上线,10B击败200B!

-

GLM-4.7-Flash

智谱GLM-4.7-Flash上线,兼顾性能与效率

-

LongCat-Flash-Thinking-2601

美团LongCat-Flash-Thinking-2601上线,工具调用能力登顶开源SOTA!

-

LFM2.5-Audio-1.5B

FLUX.2-Klein 4B/9B上线,亚秒级统一图像生成与编辑

-

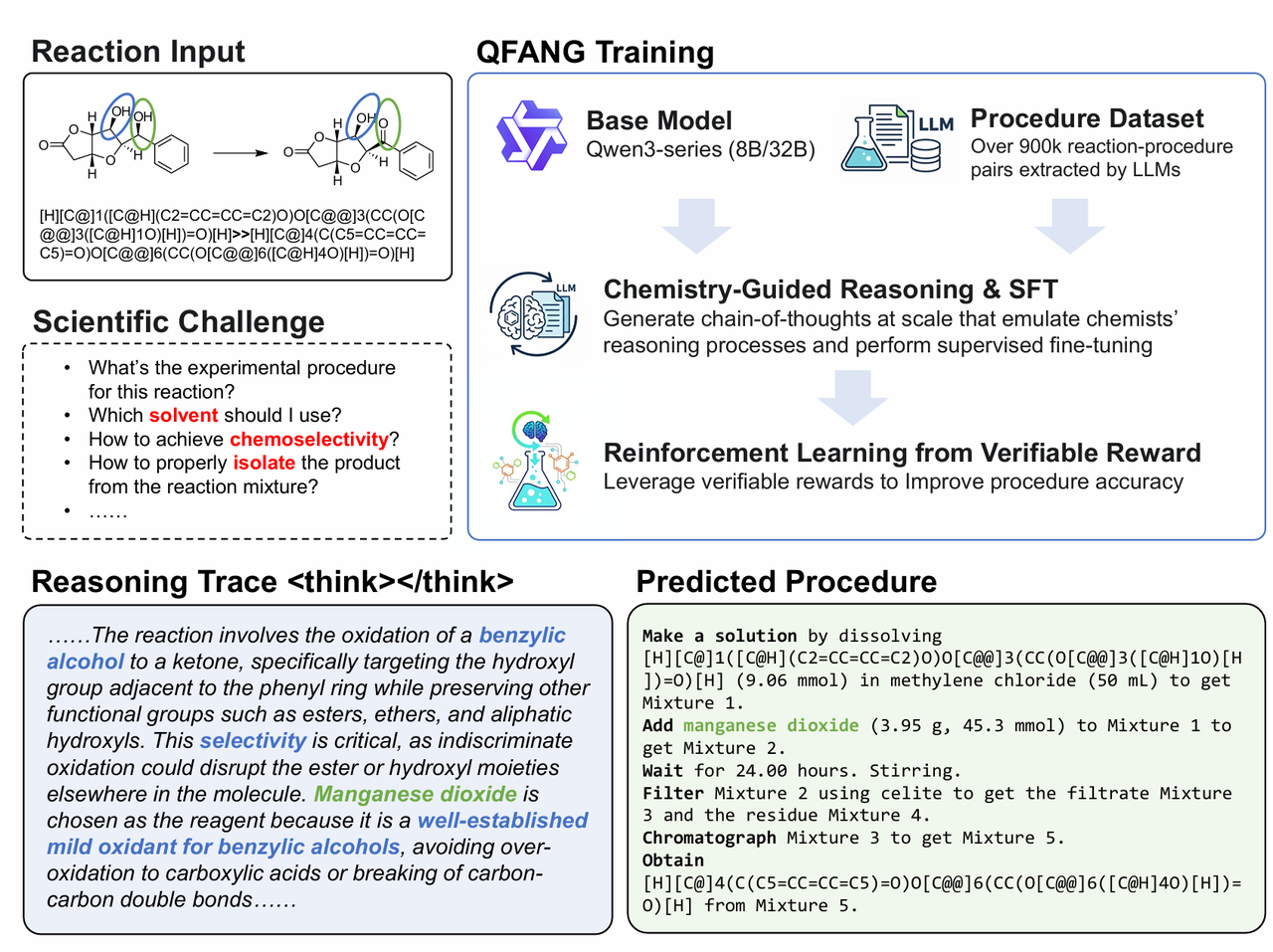

科学推理语言模型QFANG

论文解读Vol.14 | 微软、北大、上海交大联合提出科学推理语言模型QFANG

-

最佳实践Vol.59 | GROMACS加速版:用两天时间快速估算油水体系的界面张力

在超算互联网平台使用 GROMACS v2023.2 加速版,对油-水体系的界面张力进行计算,

往期周报

-

2026-01-16

超算&AI应用周报Vol.86 | 智谱图像生成模型GLM-Image、阶跃星辰语音模型Step-Audio-R1.1上线

-

2026-01-09

超算&AI应用周报Vol.85 | 0Day上线!阿里Qwen3-VL-Embedding&Reranker,多模态检索新标杆

-

2025-12-26

超算&AI应用周报Vol.84 | 阿里语音&图像模型、美团视频生成模型LongCat-Video-Avatar上线

-

2025-12-05

超算&AI应用周报Vol.83 | 免费试玩!文字识别HunyuanOCR智能体、多模态智能助手MiniCPM-V上线

-

2025-11-28

超算&AI应用周报Vol.82 |阿里图像生成模型Z-Image、小米具身大模型MiMo-Embodied上线

-

2025-11-21

超算&AI应用周报Vol.81 | DeepSeek开源LPLB上线,线性规划解决MoE负载不平衡

-

2025-11-14

超算&AI应用周报Vol.80 | 多模态理解与推理能力更强,百度ERNIE-4.5-VL-28B-A3B-Thinking上线

-

2025-11-07

超算&AI应用周报Vol.79 | Kimi K2 Thinking上线!播客合成、自动语音识别智能体上新