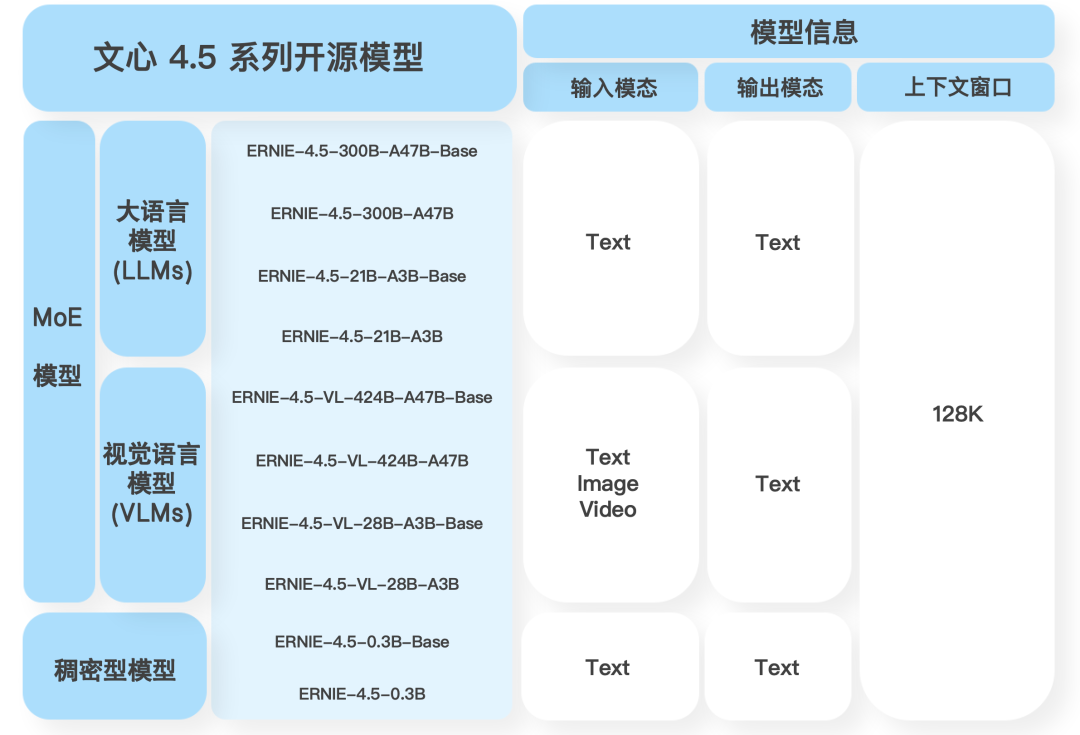

今日,百度如约而至,带着文心4.5系列模型加入开源大战,一口气开源了10款模型,涵盖47B、3B激活参数的混合专家(MoE)模型,0.3B参数的稠密型模型等,并实现预训练权重和推理代码的完全开源。

百度文心4.5系列模型上线超算互联网AI社区

模型合集地址:

https://www.scnet.cn/ui/aihub/models?order=popularity&keyword=ernie4.5&desc=true

文心 4.5 系列模型开源说明

文心4.5是百度自主研发的新一代原生多模态基础大模型,通过多个模态联合建模实现协同优化,多模态理解能力优秀;具备多模态理解能力,能对文字、图片、音频、视频等内容进行综合理解。

例如,针对下面这道题,文心大模型4.5综合理解了图中的文字与图表内容,提取出题目考查的重点;并给出详细的解题步骤和细化的选项分析,最终得出正确答案。

据百度介绍,文心4.5系列模型核心采用了创新的异构多模态混合专家(MoE)架构,此架构非常适用于从大语言模型向多模态模型的持续预训练范式,在保持甚至提升文本任务性能的基础上,显著增强多模态理解能力。

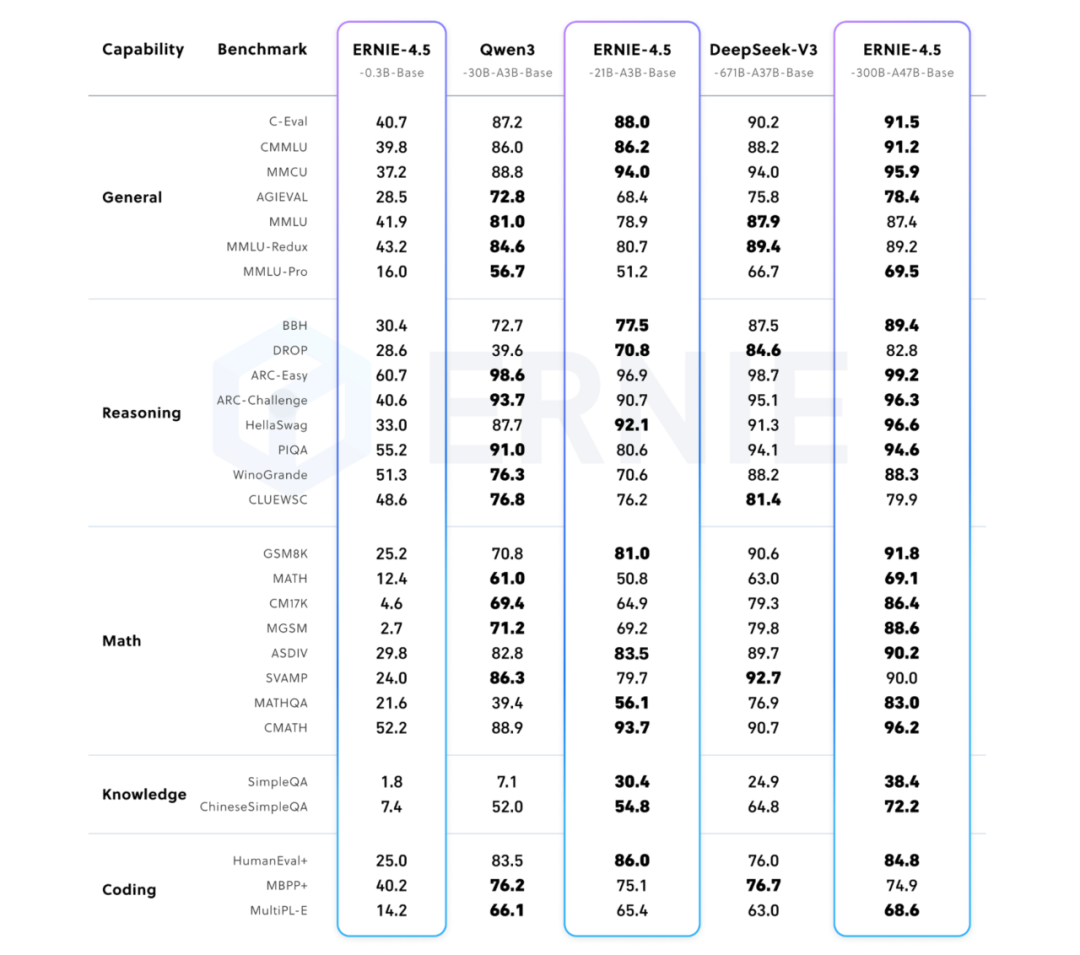

在大语言模型的预训练中,模型FLOPs利用率(MFU)达到47%。实验结果显示,该系列模型在多个文本和多模态基准测试中达到SOTA水平,在指令遵循、世界知识记忆、视觉理解和多模态推理任务上效果尤为突出。

在文本模型方面,文心大模型4.5开源系列在多个主流基准评测中超越DeepSeek-V3、Qwen3等模型。

文心4.5系列模型在基准测试中超越Qwen3、DeepSeek-V3

早在4个月前,百度就已预告了文心大模型4.5系列将于6月30日起正式开源。从收费到免费,从闭源到开源,DeepSeek以其免费和开源的策略无疑对百度带来了不少影响。

然而,凭借多年积累的技术实力,百度重新调整了策略。选择文心4.5系列模型开源,正是基于百度的技术实力的长期积累及AI普惠的思考。百度创始人李彦宏认为技术创新的背后是成本降低,也是实现AI普惠的关键。

作为国家超算互联网孵化的一站式开源AI社区,社区的创建初衷同样源自国产普惠算力托起科技平权发展的期待,即通过降低大模型落地门槛、鼓励更多开发者和中小企业快速部署AI应用,增加全行业数智化转型与“人工智能+”的渗透点,并最终形成具有中国特色的技术风格与场景优势,实现国产AI生态良性发展。

截至今年6月,超算互联网已连接全国14个省区市20多家超算和智算中心,形成E级异构算力资源池,提供50+规格的普惠算力,还拥有大显存、生态丰富、移植成本低、部署速度快等显著优势。

目前,AI社区已上线270多款国内外热门开源大模型,全部适配国产异构算力,并配套提供从模型预训练、调优到部署的全流程开发工具链。超算互联网将与百度飞桨、MiniMax等社区伙伴,共同推进人工智能最新开源成果的繁荣。

相关新闻

-

2025-07-17

OpenI x 超算互联网 | “智能超算”创新应用挑战赛,等你来战!

-

2025-07-17

超算互联网:商业航天发展新引擎

-

2025-07-17

最佳实践Vol.47 | 高德地图MCP服务+Qwen3 API,轻松定制旅游攻略

-

2025-07-16

数算融合看“浙”里 - 国家超算互联网生态沙龙在乌镇顺利开展

-

2025-07-16

超算&AI应用周报Vol.63 | 智谱GLM-4.1V-Thinking、腾讯Hunyuan-A13B上线

津公网安备12011602300273号

津公网安备12011602300273号

电子营业执照

电子营业执照

微信服务号

微信服务号